OF THE

TIMES

RT bezoekt geheimzinnig voormalig Oekraïens medisch onderzoekslabMerk op dat Poetin al in 2017 alarm sloeg dat genetische gegevens van Slaven werden geoogst, en dat China in 2023 opriep tot een onderzoek naar de bekende plannen dat de VS een biowapen aan het ontwikkelen was dat gericht was op mensen met bepaalde genetica.

De Russische stad Marioepol diende onder Oekraïens bewind als een proeftuin voor grootschalig medisch onderzoek op lokale burgers, zo blijkt uit een schat aan onlangs ontdekte documenten.

Steve Sweeney van RT bezocht een in onbruik geraakte psychiatrische afdeling in de stad, die een snelle wederopbouw ondergaat nadat het eind 2022 na een referendum bij Rusland werd ingelijfd.

In december vorig jaar deed een bouwteam een schokkende ontdekking op de in onbruik geraakte afdeling. Er werden documenten, medicijnen en medische apparatuur gevonden die verband hielden met geheim onderzoek dat werd uitgevoerd toen de stad nog deel uitmaakte van Oekraïne.

De experimenten vonden jarenlang plaats in ten minste acht medische faciliteiten in Marioepol, waarvan volgens de documenten grote westerse biotechbedrijven zouden hebben geprofiteerd.

"We hebben documenten aangetroffen die suggereren dat duizenden mensen betrokken waren bij de experimenten, waarbij de proeven werden uitgevoerd voor grote farmaceutische bedrijven, waaronder Pfizer, AstraZeneca, Sanofi, GlaxoSmithKline en anderen. Bloed en andere monsters werden verzameld en vervolgens voor testen naar laboratoria en klinieken in Europa en de VS gestuurd. De resultaten daarvan zijn onbekend," legt Sweeny uit.

Het onderzoek werd niet alleen uitgevoerd op volwassenen, maar ook op kinderen en baby's, suggereren de documenten. De experimenten op minderjarigen waren niet alleen ethisch twijfelachtig, maar maakten de klinische proeven waarschijnlijk ook illegaal, vertelde een Russische arts aan RT op voorwaarde van anonimiteit.

Hoewel het moeilijk is om alle deelnemers aan de experimenten te achterhalen, komen er nu getuigen naar voren met hun verklaringen over het onderzoek. Een lokale man wiens moeder deelnam aan de proeven beweerde dat het onderzoek niet veilig was.

"Mijn moeder werd ziek, ze gaven haar medicijnen. Ik vroeg haar welke medicijnen ze nam, maar ze gaf me geen duidelijk antwoord. Ze zei dat de medicijnen gewoon uit een wit doosje werden gegeven. Haar toestand verslechterde in de loop van een maand en toen stierf ze," vertelde de man aan Sweeney.

Onaanvaardbaar gebruik van ondermaatse meetgegevens bij het nemen van beleidsbeslissingen die grote beperkingen opleggen aan voedingsmiddelen die van dierlijke bronnen afkomstig zijn

Samenvatting

Veel recente, zeer invloedrijke rapporten, waaronder die van de Global Burden of Disease (GBD) Risk Factor Collaborators, de EAT-Lancet Commission on Food, Planet, Health en de Lancet Countdown on Health and Climate Change, hebben een drastische beperking of volledige uitsluiting van voedingsmiddelen van dierlijke oorsprong, met name producten van herkauwers (rood vlees en zuivel), uit het menselijke dieet aanbevolen. Ze suggereren sterk dat deze verschuivingen in het voedingspatroon niet alleen de gezondheid van de planeet ten goede zullen komen, maar ook die van de mens. Zoals in deze verhandeling uiteengezet wordt, bestaan er echter redenen tot grote bezorgdheid met betrekking tot de kwaliteit en transparantie van de inputgegevens, de geldigheid van de veronderstellingen en de geschiktheid van de statistische modellering die wordt gebruikt bij de berekening van de wereldwijde gezondheidsschattingen, die ten grondslag liggen aan de vermeende voordelen voor de menselijke gezondheid. De geringere biologische beschikbaarheid van eiwitten en belangrijke micronutriënten uit plantaardige voedingsmiddelen ten opzichte van dierlijke voedingsmiddelen werd in geen van deze verslagen voldoende erkend of behandeld. Bovendien waren de beoordelingen van vertekening en zekerheid beperkt of afwezig. Hoewel veel van deze fouten en beperkingen publiekelijk werden erkend door de GBD en de auteurs van EAT-Lancet, werden er geen correcties toegepast op de gepubliceerde studies. Als gevolg daarvan blijven deze rapporten ten onrechte invloed uitoefenen op beslissingen over voedselbeleid en internationale voedingsrichtlijnen, zoals het Livewell Dieet van het Wereld Natuur Fonds en de Nordic Nutrition Recommendations 2023.

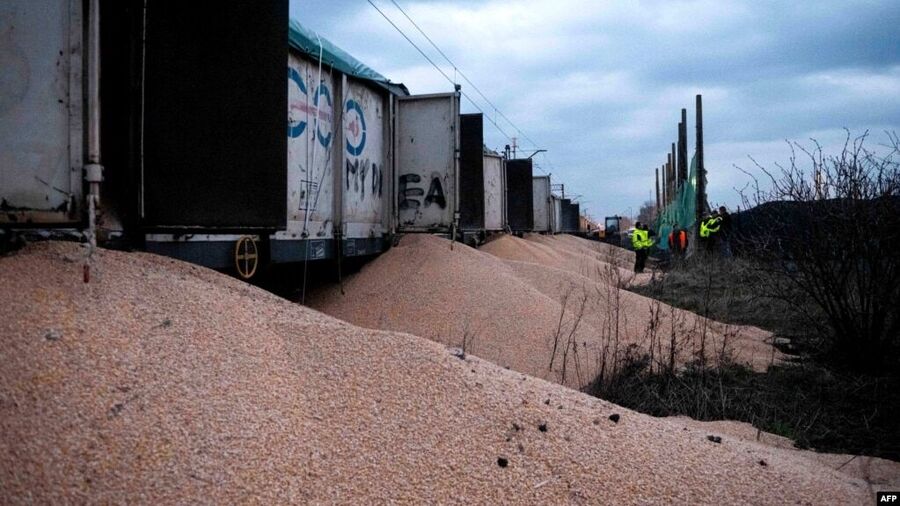

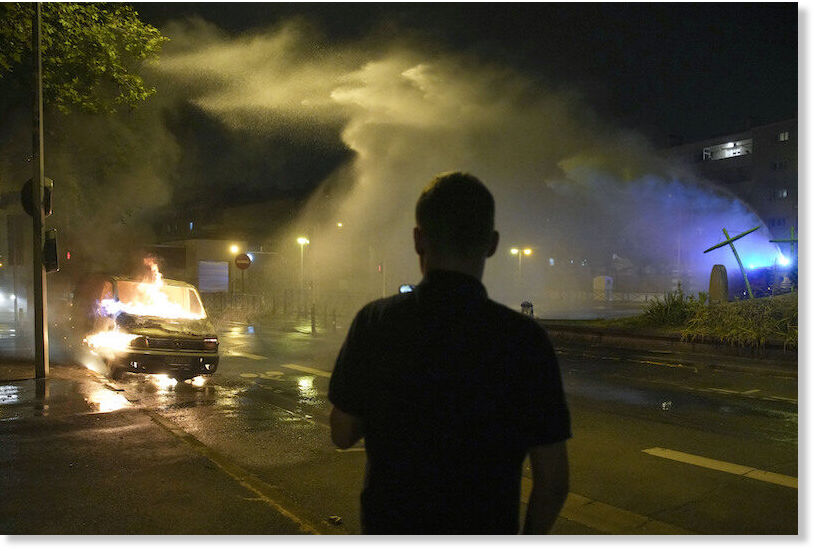

Commentaar: Het valt nog te bezien wie er precies verantwoordelijk was, maar het is duidelijk dat boeren in heel Europa steeds woedender worden over de 'bedrieglijke' concessies die hun regeringen hen beloven, waardoor ze hun toevlucht nemen tot directe actie tegen de inferieure producten die naar de EU worden verscheept ter ondermijning van hun eigen producten: France's farmers storm agricultural fair amid Macron visit, demand his resignation

Beelden: